운동화 삑삑 소리의 물리학, 그리고 AI가 바꿀 소음 진단의 미래

지난주 네이처에 재미있는 논문이 올라왔다. 하버드의 재료과학자 Adel Djellouli가 보스턴 셀틱스 경기를 관람하다가 농구화의 '삑삑' 소리에 호기심을 품고 연구실로 돌아가 운동화를 유리판 위에서 밀면서 초고속 카메라로 촬영한 것이다. 결과는 놀라웠다. 신발 밑창이 바닥과 마찰할 때 시속 300km에 달하는 파동형 변형이 밑창을 가로질러 쓸고 지나가며, 이 파동이 반복되는 주기가 우리가 듣는 삑삑 소리의 주파수와 정확히 일치했다. 지진의 전파 메커니즘과 번개의 발생 원리가 고무 밑창 위에서 재현되고 있었던 셈이다. 밑창의 두께와 강성을 바꾸면 음높이가 달라진다는 것도 밝혀냈다. 언젠가는 인간의 가청 주파수 위로 소리를 올려서 '조용한 농구화'를 설계할 수 있을지도 모른다.

이 연구는 AI도 머신러닝도 쓰지 않았다. 초고속 카메라, 마이크로폰, 그리고 물리학의 기본 원리만으로 마찰 계면에서 벌어지는 현상을 규명해냈다. 하지만 이 논문을 읽으면서 나는 전혀 다른 방향으로 생각이 흘러갔다. 소리로 무언가의 상태를 알아내려는 시도들, 그리고 그 시도들이 왜 기대만큼 성공하지 못했는지에 대해서.

소리는 인류 최초의 비파괴 진단 도구였다

소리로 상태를 진단하려는 시도는 인류 역사만큼이나 오래되었다. 가장 흔하게 볼 수 있는 것이 의사의 청진기다. 1816년 르네 라에네크가 발명한 이래 200년 넘게 의사들은 가슴에 청진기를 대고 심장과 폐의 소리를 듣는다. 정상인의 심음과 판막 질환 환자의 심음은 다르다. 숙련된 의사는 그 차이를 귀로 잡아낸다.

최근에는 자동차 유튜버들 사이에서 재미있는 진단법이 유행한다. 후드를 열고, 시동이 걸린 엔진 위에 긴 쇠막대의 한쪽 끝을 갖다 대고, 다른 쪽 끝에 귀를 대는 것이다. 일종의 원시적 청진기인 셈인데, 이걸로 베어링 마모나 텐셔너 이상 같은 문제를 꽤 정확하게 짚어낸다. 소리의 맥동과 리듬을 통해 측정 대상의 이상 유무를 판단하는 행위다.

우리는 시간에 따른 사운드의 강도를 들으면서 살아간다. 하지만 인간의 청각 시스템은 단순히 '시끄럽다/조용하다'만 감지하는 것이 아니다. 인간의 귀와 뇌는 놀랍게도 주파수 분해, 즉 푸리에 변환과 유사한 처리를 물리적으로 수행한다.

당신의 달팽이관은 생물학적 스펙트럼 분석기다

여기서 잠깐, 푸리에 변환에 대해 이야기해보자.

세상의 모든 소리는 파형(waveform)이다. 마이크로 녹음하면 시간 축 위에 진폭이 올라갔다 내려갔다 하는 물결 모양이 찍힌다. 이것이 우리가 '소리'라고 부르는 것의 정체다. 시간(t) 대 진폭(amplitude). 하지만 이 파형만 보고는 그 안에 어떤 음이 섞여 있는지 알 수가 없다. 피아노의 '도' 음, 바이올린의 '도' 음, 사람 목소리의 '도' 음은 모두 같은 기본 주파수를 가지지만, 파형의 모양은 전혀 다르다. 거기에 각각 다른 배음(harmonic)들이 다른 비율로 섞여 있기 때문이다.

푸리에 변환은 이 복잡한 파형을 말아서 원으로 감는다고 상상하면 된다. 3Blue1Brown의 그 유명한 비유를 빌리자면, 시간 축 위의 파형을 특정 주파수로 원형 궤도 위에 감아보는 것이다. 만약 감는 주파수가 파형 속에 실제로 존재하는 주파수와 일치하면, 감긴 파형의 무게중심이 원의 중심에서 크게 벗어난다. 일치하지 않으면 무게중심은 거의 중심에 머문다. 이 무게중심의 편차를 모든 주파수에 대해 계산하면, 원래 파형 속에 어떤 주파수가 얼마나 강하게 포함되어 있었는지를 알 수 있다. 시간 도메인(t, amplitude)의 정보가 주파수 도메인(f, magnitude)으로 변환되는 것이다.

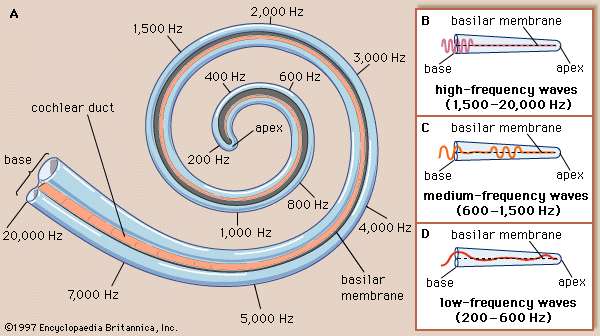

놀라운 것은, 인간의 달팽이관(cochlea)이 바로 이 작업을 물리적으로 수행한다는 점이다. 달팽이관 안에는 기저막(basilar membrane)이라는 얇은 막이 나선형으로 감겨 있다. 이 막은 입구 쪽(기저부)은 짧고 단단하고, 끝 쪽(첨부)으로 갈수록 길고 유연해진다. 소리 진동이 달팽이관 속 액체를 통해 전파되면, 기저막의 각 위치는 자신의 고유 공명 주파수에 해당하는 성분에만 강하게 반응한다. 기저부는 고주파, 첨부는 저주파. 마치 피아노 건반처럼, 주파수가 물리적 공간 위에 펼쳐지는 것이다. 이것을 tonotopic organization이라 부른다.

엄밀히 말하면 달팽이관이 수행하는 것은 순수한 푸리에 변환이 아니라 웨이블릿 변환(wavelet transform)에 더 가깝다. 푸리에 변환은 시간 정보를 완전히 잃어버리지만, 달팽이관은 '어떤 주파수가, 언제, 얼마나 강하게' 존재하는지를 동시에 인코딩한다. 시간 해상도와 주파수 해상도 사이의 절묘한 균형을 유지하는 것이다. 그래서 인간은 여러 주파수가 합성된 사운드의 이질감, 즉 음의 파형이나 리듬의 미세한 변화를 알아차릴 수 있다. 그리고 의사나 자동차 정비사처럼 오랜 시간 쌓인 경험 데이터가 이 감각을 '진단 능력'으로 승격시킨다.

DFT에서 FFT로: 기계가 소리를 '이해'하기 시작하다

역사적으로 보면, DFT(Discrete Fourier Transform)의 등장은 혁명적이었다. 소리를 시간과 강도의 세계에서 주파수의 세계로 끌어올 수 있게 되었기 때문이다. 물리적 현장에서 벌어지는 x, y, t 좌표의 복잡한 현상을 f(주파수)와 t(시간)의 2차원으로 압축해서 사고할 수 있게 된 것이다. 스펙트로그램이라는 표현 도구가 탄생했고, 음향학은 비로소 정량적 학문이 되었다.

그리고 1965년, Cooley와 Tukey가 FFT(Fast Fourier Transform) 알고리즘을 발표하면서 판이 완전히 바뀌었다. N개의 데이터 포인트에 대해 O(N²)이 필요하던 계산이 O(N log N)으로 떨어졌다. 이 말은 컴퓨터가 실시간으로 소리를 주파수 성분으로 분해할 수 있게 되었다는 뜻이다. 역설적으로, 인간이 오랫동안 '귀의 감각'에 의존하던 영역에 알고리즘이 진입할 수 있는 문이 열린 것이다.

주파수 도메인으로 분리된 소리로 기계의 상태를 판별하는 기술, 즉 음향 기반 비파괴 검사(Acoustic-based Non-Destructive Testing)가 본격적으로 연구되기 시작했다.

LG전자 공장에서의 실전: 왜 실험실의 90%가 공장의 0%가 되었나

내가 LG전자에 있던 2010년대, 공장에서는 꽤 야심찬 프로젝트가 진행되고 있었다. 조립이 끝난 제품에 전원을 넣고 시험 동작을 시킨 뒤, 그 동작 소음을 분석해서 고장 여부를 판별하겠다는 것이었다. 매우 혁신적인 비파괴 검사법이었다. 제품을 뜯어보지 않고도, 단순히 켜서 돌려보기만 하면 모터 불량, 조립 공차 이탈, 부품 간섭 같은 문제를 소리 하나로 선별해낼 수 있다는 발상이었다.

실험실에서의 성과는 인상적이었다. 정확도 90%에 육박하는 알고리즘이 나왔다. 하지만 이 알고리즘이 공장 라인에 투입되는 순간, 맥을 추지 못했다.

첫 번째 한계는 측정 환경이었다.

알고리즘은 매우 정확한 측정 지오메트리를 요구했다. 마이크의 위치, 각도, 거리가 밀리미터 단위로 통제되어야 했다. 실험실에서는 당연한 조건이지만, 공장은 다른 세상이다. 사람들이 움직이고, 볼펜을 떨어뜨리고, 대화를 나누고, 옆 라인의 장비들이 돌아간다. 컴프레서 소음, 컨베이어 모터음, 에어건 소리가 끊임없이 섞여 들어온다. 이러한 노이즈 환경에서 타겟 제품의 동작음만 추려내는 것은 대단히 어려운 일이었다.

두 번째 한계는 데이터에 있었다.

이 알고리즘을 학습시키려면 '동작 소음(x)과 고장 원인(y)이 쌍으로 존재하는' 대량의 실제 고장 데이터가 필요했다. 그런데 고장 난 제품은 공장에서 자주 나오지 않는다 (나오면 더 큰 문제다). 설령 나오더라도, 그 제품의 동작 소음이 반드시 녹음되어 있어야 하고, 고장 원인이 정확히 분류되어 있어야 했다. 이 조건을 만족하는 데이터셋을 구하는 것, 혹은 직접 만드는 것이 프로젝트 업무의 8할이었다. 일부러 부품을 불량으로 교체해서 제품을 조립하고, 소리를 녹음하고, 다시 분해하는 작업을 반복했다. 이게 얼마나 비효율적인 작업인지는 해본 사람만 안다.

결국 소리로 무언가를 알아내려는 연구는 처음의 열광에 비해 실제 성과가 미미했고, 점점 사람들의 관심에서 멀어져 갔다.

AI가 바꿀 게임의 법칙

그러나 앞으로는 다를 것이다. AI가 있기 때문이다.

과거의 접근은 인간이 물리적 원리를 이해하고, 특정 주파수 대역에서 특정 패턴을 찾아내는 명시적(explicit) 알고리즘을 설계하는 것이었다. 깔끔한 데이터, 통제된 환경, 명확한 인과 관계가 필요했다. 인간의 통계적 직관이 닿는 범위 안에서만 작동하는 방식이었다.

AI 시대의 접근은 근본적으로 다르다. 이제 x 데이터는 그냥 무지성으로 수집된 공장의 사운드 녹음 파일이면 된다. 마이크 위치가 좀 바뀌어도, 옆에서 누가 떠들어도, 컨베이어 소음이 섞여 있어도 상관없다. y 데이터는 고장이 확인된 제품의 시리얼 넘버만 있으면 된다. 나머지는 AI가 처리한다.

인간의 통계적 기술로는 상상할 수 없는 계산을 해낼 것이다. 공장 배경음의 시간대별, 요일별 노이즈 패턴을 스스로 학습해서 자동으로 분리할 것이다. 타겟 제품의 사운드 시그니처만을 증폭해서 고장의 미세한 신호를 추출해낼 것이다. 수만 개의 정상 제품 소리와 수십 개의 불량 제품 소리만으로도 이상 탐지(anomaly detection)를 수행할 것이다. 라벨 없는 데이터에서도 구조를 찾아낼 것이다.

과거에 비해 입력은 정말 단순해졌지만, 출력은 놀라울 만큼 정확해질 것이다.

90년대 신경망 연구자들은 이 미래를 알았을까

이러한 미래가 올 줄 90년대 신경망 연구자들은 알고 있었을까?

나는 몰랐을 것이라 생각한다. RISC가 CISC를 압도하는 날이 올 줄도 몰랐던 것처럼, GPU가 CPU를 압도할 줄 몰랐던 것처럼, 그리고 트랜스포머가 CNN과 RNN을 한 방에 날려버릴 줄 몰랐던 것처럼 말이다.

우리는 거시적으로 무지의 영역에서 살고 있다. 거의 눈을 감고 있다고 해도 과언이 아니다. 그러면서도 아주 미시적인 영역에서 조금의 잘남을 뽐내려고 자신의 깃털을 한껏 부풀리며 살고, 남들은 그것을 보며 부러워하고, 자신의 깃털을 부풀리기 위해 노력한다.

하지만 AI의 등장으로, 미시적 영역에서의 이런 아전인수는 점점 설 자리를 잃어가고 있다. 주파수 하나 더 구분할 줄 안다고, 알고리즘 하나 더 짤 줄 안다고, 통계 모델 하나 더 돌릴 줄 안다고 뽐내던 깃털들이 하나둘 의미를 잃는다.

점점 더 인간에게 요구되는 능력은 거시적인 영역에서의 시력이 되어 간다. 숲을 보는 눈, 방향을 잡는 감각, 아직 아무도 질문하지 않은 것을 질문하는 능력. 보스턴 셀틱스 경기장에서 농구화 삑삑 소리에 "왜?"를 물을 수 있는 호기심 같은 것 말이다.............